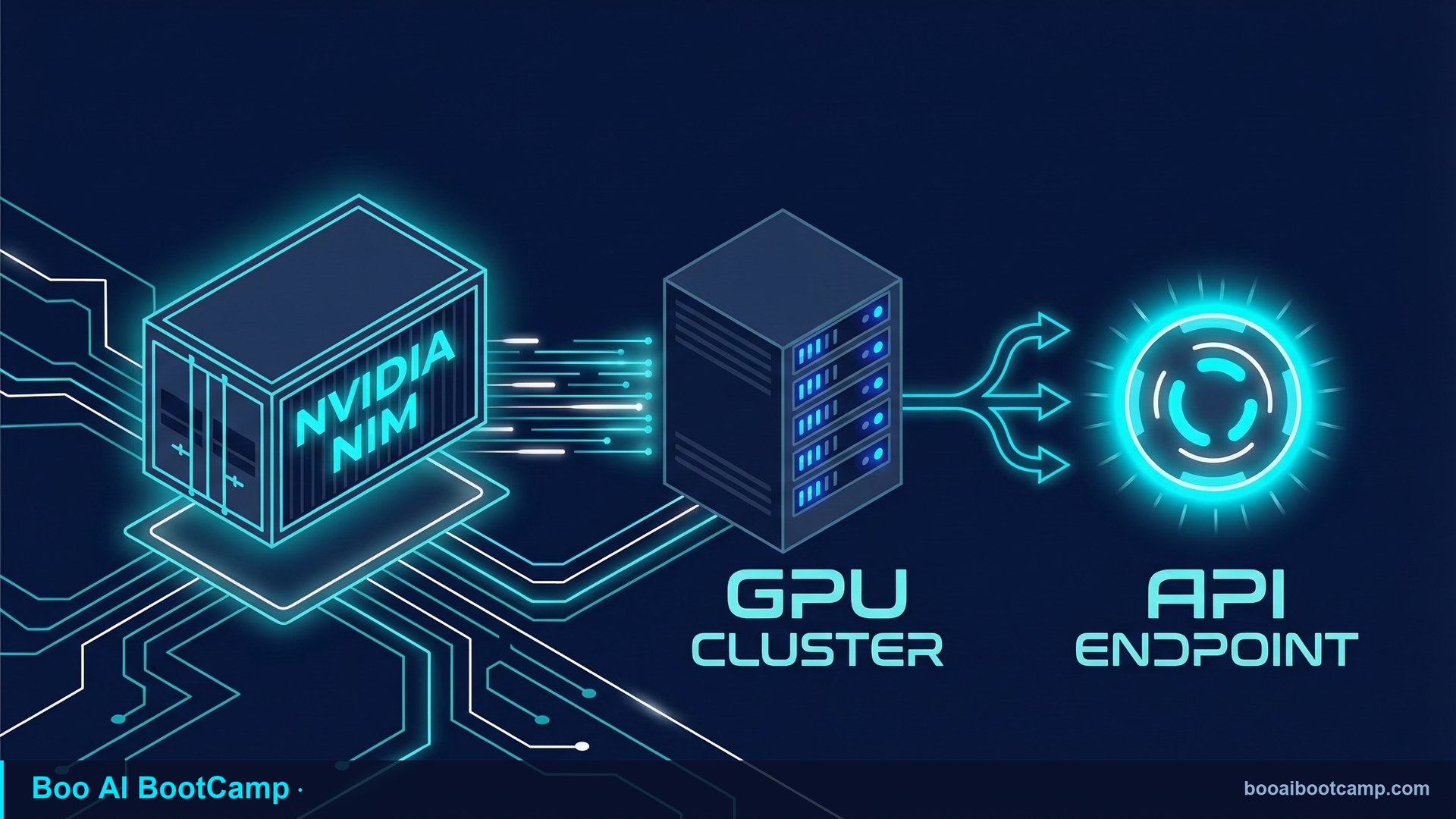

NVIDIA NIM คืออะไร?

NIM (NVIDIA Inference Microservices) คือ containerized AI models ที่ Nvidia pre-optimize แล้วสำหรับ NVIDIA GPU พร้อม OpenAI-compatible API

ทำไม NIM ดีกว่า Self-hosting ทั่วไป?

ก่อน NIM:

1. Download model weights

2. Setup environment (CUDA, dependencies)

3. Optimize for GPU (quantization, batching)

4. Build API server

5. Handle scaling

เวลา: 1-2 weeksกับ NIM:

ash

docker run --gpus all -e NGC_API_KEY= nvcr.io/nim/meta/llama-3.1-8b-instruct:latest

เวลา: < 1 ชั่วโมงModels ที่ NIM รองรับ

| Category | Models |

|---|---|

| LLM | Llama 3.1, Mistral, Gemma, Phi-3 |

| Embedding | NV-EmbedQA, E5 |

| Reranking | NV-RerankQA |

| Vision | CLIP, NVLM |

| Speech | Parakeet ASR, FastPitch TTS |

API ที่ Compatible กับ OpenAI

python

from openai import OpenAI

client = OpenAI(

base_url="http://localhost:8000/v1",

api_key="not-needed"

)

response = client.chat.completions.create(

model="meta/llama-3.1-8b-instruct",

messages=[{"role": "user", "content": "Hello"}]

)

เหมาะกับองค์กรแบบไหน?

✅ มี NVIDIA GPU on-premise หรือ cloud

✅ Data privacy สำคัญ (ข้อมูลอยู่ใน network ตัวเอง)

✅ ต้องการ consistent latency

✅ Volume สูงพอที่ self-hosting คุ้มกว่า API

สรุป

NIM ลด barrier การ deploy AI model ใน enterprise จาก "ต้องมี ML engineer" เป็น "DevOps ก็ทำได้" เหมาะสำหรับองค์กรที่จริงจังกับ on-premise AI

พร้อมนำ AI ไปใช้ในธุรกิจคุณหรือยัง?

เวิร์กช็อป 1:1 ที่ออกแบบตามบริบทธุรกิจของคุณ เพื่อให้เริ่มใช้ AI ได้อย่างเป็นระบบและวัดผลได้จริง

จองรอบเรียน