สร้าง Enterprise Q&A ด้วย RAG

หลายองค์กรมีเอกสาร manual, SOP, และ policy หลายร้อยไฟล์ที่พนักงานหาข้อมูลจากนั้นไม่ออก RAG AI แก้ปัญหานี้ได้

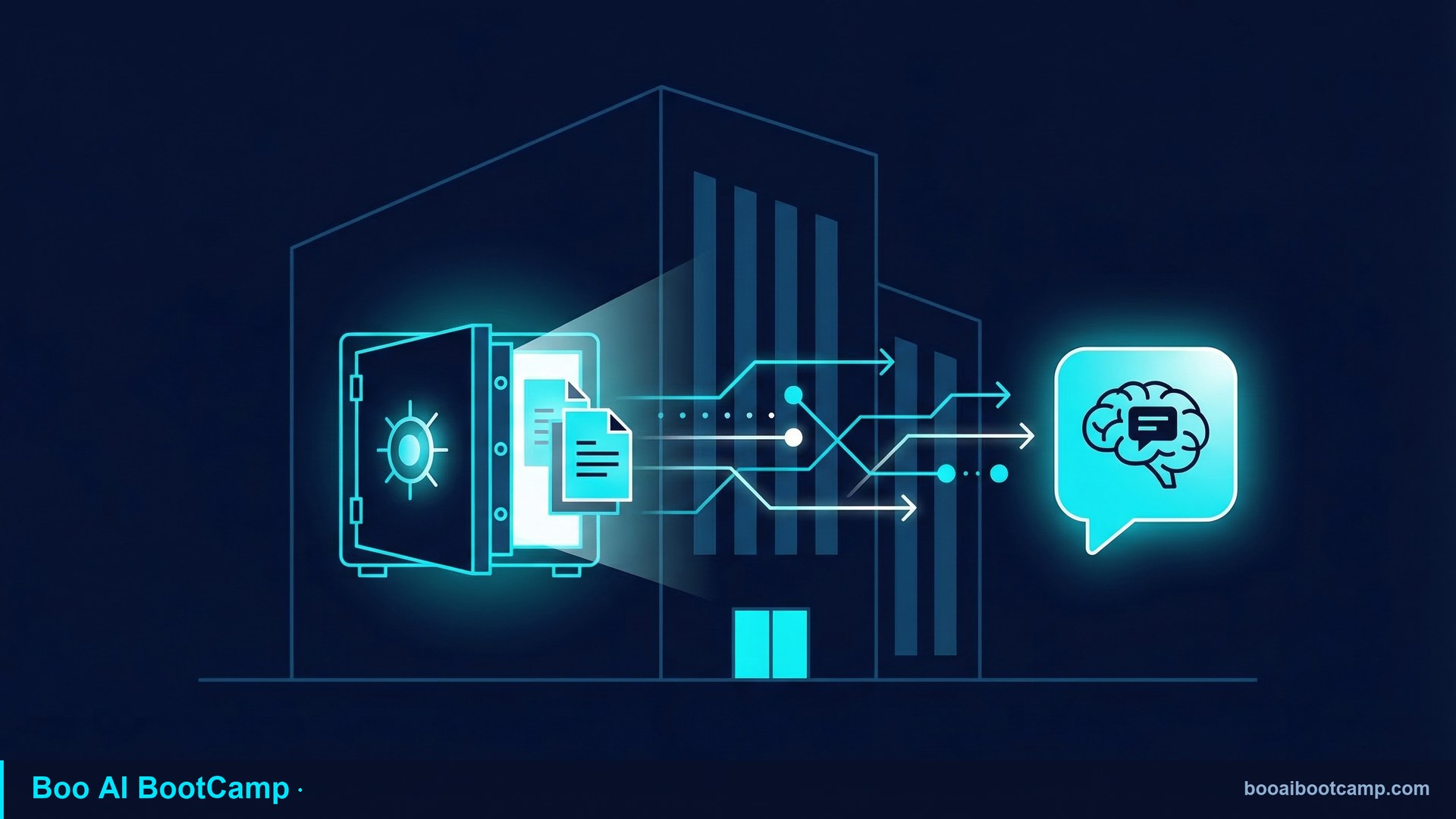

Architecture ที่แนะนำ

Documents (PDF/Word/Web) ↓ Parse & Chunk ↓ Embedding Model ↓ Vector Database (Chroma/Pinecone) ↓ User Query → Embed → Search → Context → LLM → Answer

ขั้นตอนสร้างระบบ

Step 1: เตรียมเอกสาร

- รวบรวมไฟล์ทั้งหมด

- แปลงเป็น text (PDF → text)

- แบ่ง chunk ขนาด ~500 tokens

Step 2: สร้าง Vector Store

python

from langchain.vectorstores import Chroma

from langchain.embeddings import OpenAIEmbeddings

vectorstore = Chroma.from_documents(

docs, OpenAIEmbeddings()

)

Step 3: สร้าง QA Chain

python

from langchain.chains import RetrievalQA

qa = RetrievalQA.from_chain_type(

llm=ChatOpenAI(),

retriever=vectorstore.as_retriever()

)

Case Study: บริษัทประกัน

ปัญหา: พนักงาน call center ต้องค้นเอกสาร 200+ หน้าเพื่อตอบลูกค้า

ผล: ลดเวลาตอบจาก 3 นาที → 30 วินาที หลังใช้ RAG Q&A

สรุป

RAG + Knowledge Base เป็น investment ที่คุ้มค่าสำหรับองค์กรที่มีเอกสารเยอะ ลดเวลาค้นหา เพิ่มความถูกต้อง

พร้อมนำ AI ไปใช้ในธุรกิจคุณหรือยัง?

เวิร์กช็อป 1:1 ที่ออกแบบตามบริบทธุรกิจของคุณ เพื่อให้เริ่มใช้ AI ได้อย่างเป็นระบบและวัดผลได้จริง

จองรอบเรียน